【調査結果】「性的ディープフェイク」、半数以上が認知。被害認知も増加。生成AIによる子どもの人権侵害への対策は、法規制、業界規制、そして子ども自身のAIリテラシー向上を。

特定非営利活動法人チャイルド・ファンド・ジャパン(東京都杉並区、事務局長:武田勝彦)は、全国の15~79歳の男女を対象にした「生成AIと子どもの人権侵害」に関する国民意識調査を2026年にも行いました。

調査結果から、性的ディープフェイクを知っている人が増えており、オンライン上の子どもの権利侵害への法令規制と業界規制とともにAIリテラシーなどの自己防衛力の習得を求める声が増えていることが分かりました。

生成AIやディープフェイクから子どもの権利を守る!アドボカシー活動は、子ども・若者視点で。

急速な進化と普及を遂げた生成AIにより、大量の画像が瞬時に作成・拡散されるようになった昨今、生成AIによる子どもの性虐待コンテンツ「Child Sexual Abuse Material / シーサム」(以下、CSAM)や性的ディープフェイクの問題が広がりつつあり、法整備や社会の意識の向上が求められています。

チャイルド・ファンド・ジャパンでは、これまでに、子どもたちを性搾取から守るための取り組みとして、若者を対象としたグルーミングに関する調査や、子どもや若者にグルーミングの注意喚起をするため、アニメーション動画の作成を行ってきました。また、2024年4月にシンポジウム「生成AIの子どもの権利への脅威」、12月に海外の先駆的な取組を学ぶオンラインセミナーを開催。さらに、専門家によるワーキンググループを発足し、生成AIによるCSAMを規制する新法づくりに向けた提言などを行っています。

チャイルド・ファンド・ジャパンは上記の取り組みの一環として、生成AIが子どもの人権を侵害する可能性や対応策に関する国民への意識調査を実施しました。

調査概要

調査期間 2026年1月25日(日)~2月7日(土)

調査対象 全国の15〜79才の男女

回答数 1,200名

調査方法 調査員による個別訪問留置調査(乗合方式)

調査実施機関 株式会社日本リサーチセンター

調査から明らかになった主な点は、以下のとおりです。

調査結果分析概要

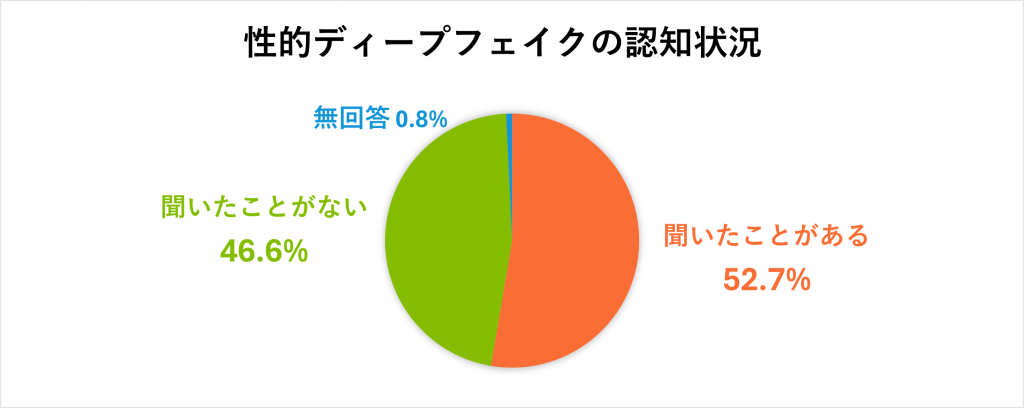

① 性的ディープフェイクは全体の半数が知っているが、女性の方が認知率が低く、特に15-19歳が低い。性的ディープフェイクの認知経路は、若年層はSNS・ネット、高齢層はマスメディアとかなりはっきり分かれている。

② 身近な未成年で生成AIによるCSAM被害があると回答した割合は、前回の0.3%から今回は0.7%に増加しており、CSAM被害の広がりや問題への認知の拡大の可能性がうかがえる。

③ 未成年の加害防止策には、学校教育の強化に続いて社会意識の向上が高い。女性では、環境づくりやペアレントコントロールなど家庭での対策が必要と考えている割合が高い。

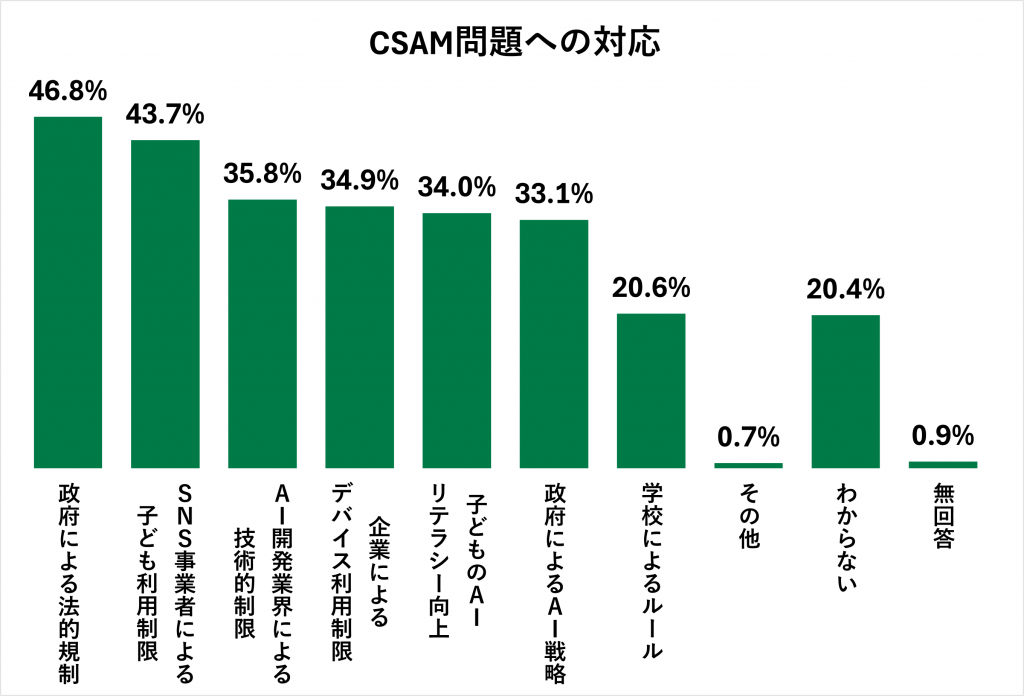

④ CSAM問題への対応として、政府や企業に規制を期待する人が最も多い。一方で、子ども自身のAIリテラシー向上は、前回の29.3%から今回の34.0%へと増加しており、全対応策の中で最も伸びている。特に、前回と比較して男性30代および女性30〜40代ではAIリテラシーの必要性への認識が全体的に高い傾向がみられる。

⑤ 実在・非実在児童に関する法令規制について最も多い結果は「実在する・実在しないに関わらず、すべて禁止するべき」の59.3%である。続いて、「実在する児童の性的表現が含まれる加工・合成コンテンツも禁止するべき(顔・体の一部を使用したもの/性的ディープフェイクも含む)」が18.6%と多い。一方で、「実在する児童の性的表現が含まれるコンテンツのみ禁止するべき(現行法令どおり)」は10.3%と、前回の10.8%と比較して変化は少ない。

■調査結果詳細(一部)

※調査では、用語の説明(脚注参照)をした上で、各質問をしています

問 あなたは「性的ディープフェイク」を知っていますか。

「聞いたことがある」が52.7%と約半数。

問 生成AIによる子どものCSAM問題への対応について、あなたのお考えにあてはまるものをお知らせください。

生成AIによる子どものCSAM問題への対応としては、「政府が規制する法律をつくるべき」(46.8%)、「SNSやアプリ事業者が子どものサービス利用に一定の制限をかけるべき」(43.7%)が多く、次いで「AI関連業界が技術的な規制をかけるべき」(35.8%)、「企業が子どものデバイス(スマホなど)の利用に制限をかけるべき」(34.9%)、「子ども自身がAIリテラシーを高めて自己防衛できる力をつけるべき」(34.0%)、「政府がAI戦略で規制するべき」(33.1%)が続く。

本調査の結果を踏まえ、調査チームは、以下の提言をします。

■提言

法的対応

1.生成AIによる性的ディープフェイクの被害に十分に対応できるように、児童ポルノ禁止法における「実在する児童の描写」の新たな判断基準を設定する。(例:児童の顔や身体の一部の描写も児童ポルノの定義に含める法改正)

制度的対応

1.世代ごとの情報接触媒体を活用した啓発を進める。(例:40代未満にはSNS、50代以上は新聞・マスメディア)

2.家庭・学校・社会が連携し、子どものオンライン上の性的被害について継続的に話し合える環境を整える。(例:学校や地域での親子参加型デジタル安全ワークショップ、生成AIの悪用(卒業アルバムの写真利用等)防止の啓発活動)

3.15~19歳では生成AIによるCSAM被害が見えていない可能性があり、10代の被害認識や実態を丁寧に把握する。(例:未成年への年齢に配慮した調査研究の実施)

技術的対応

1.SNSやAIのサービスを提供する企業に対し、未成年の利用に関する安全対策やCSAM防止措置を強化する。(例:注意喚起のポップアップの導入、CSAMを学習しないAIの開発設計)

チャイルド・ファンド・ジャパンでは、引き続き、子どもの権利を守るため、政策提言や子ども・若者へのさらなる調査などの活動を行ってまいります。

各質問の回答結果、分析、提言、調査票などは、こちらからご覧いただけます。

■引用・転載の際のクレジット表記のお願い

調査結果を引用・転載される際は、「特定非営利活動法人チャイルド・ファンド・ジャパン調べ」と、クレジットの記載をお願いいたします。

(脚注)

生成AI(人工知能)の発達により、子ども※1を性的な表現対象としたコンテンツ(CSAM:シーサム)※2を簡単に作成でき、それをSNSにアップロードして拡散できる状況となっています。

また、生成AIを使って「実在する子ども」の画像等から、ニセの子どもの性的なコンテンツが簡単に作成できます。さらに、「実在しない架空の子ども」の性的なコンテンツも簡単に作成可能です。

加えて、表現対象の子どもが実在するかの判定は、生成AIの発達によって難しくなっています。

※1 本テーマでの「子ども」は「18歳未満(未成年者)」を指します。

※2 「コンテンツ」とは、「画像、動画、音声等」で表現されるものを指します。「CSAM:シーサム」はChild Sexual Abuse Material の略称で、現在、法規制の対象になっていないものもあります。

「性的ディープフェイク」とは、生成AIを使って人物を作成するもので、実在の人物の顔と、偽物の裸の体を合成して作成するなど性的なコンテンツが多くあります。これらも「CSAM」にあたります。

このようなCSAMを作成するアプリやサービスも存在し、子どもにも被害が及んでいます。

また、いじめ・いやがらせに利用されることもあり、加害者が子どもの場合もあります。